-

1,351小时中国普通话语音数据_对话【数据堂】规模:1,351小时应用场景:语音识别;声纹识别查看详情

1,351小时中国普通话语音数据_对话【数据堂】规模:1,351小时应用场景:语音识别;声纹识别查看详情 -

大模型中文千万轮对话数据集规模:500万轮应用场景:大模型训练查看详情

大模型中文千万轮对话数据集规模:500万轮应用场景:大模型训练查看详情 -

大模型视频数据集【用于文生视频】规模:30W部应用场景:文生视频查看详情

大模型视频数据集【用于文生视频】规模:30W部应用场景:文生视频查看详情 -

3万组多领域客服对话文本数据【数据堂】规模:3万组应用场景:可用于自然语言理解等任务查看详情

3万组多领域客服对话文本数据【数据堂】规模:3万组应用场景:可用于自然语言理解等任务查看详情 -

大模型内容安全类文本数据【数据堂】规模:50万条应用场景:可用于自然语言理解等任务查看详情

大模型内容安全类文本数据【数据堂】规模:50万条应用场景:可用于自然语言理解等任务查看详情 -

203,029组医疗类多轮问答数据【数据堂】规模:203,029组应用场景:可用于自然语言理解等任务查看详情

203,029组医疗类多轮问答数据【数据堂】规模:203,029组应用场景:可用于自然语言理解等任务查看详情 -

1T中文学科类无监督文本数据【数据堂】规模:1T应用场景:可用于自然语言理解等任务查看详情

1T中文学科类无监督文本数据【数据堂】规模:1T应用场景:可用于自然语言理解等任务查看详情 -

2,002人电动自行车进电梯数据【数据堂】规模:2,002人应用场景:本套数据可用于电动车检测、电动车识别等任务。查看详情

2,002人电动自行车进电梯数据【数据堂】规模:2,002人应用场景:本套数据可用于电动车检测、电动车识别等任务。查看详情 -

1,652小时粤语手机采集语音数据【数据堂】规模:1,652小时应用场景:语音识别;声纹识别查看详情

1,652小时粤语手机采集语音数据【数据堂】规模:1,652小时应用场景:语音识别;声纹识别查看详情 -

830,276组人人多轮对话文本数据[数据堂]规模:830,276组应用场景:可用于自然语言理解等任务查看详情

830,276组人人多轮对话文本数据[数据堂]规模:830,276组应用场景:可用于自然语言理解等任务查看详情 - 人工智能高质量数据集服务平台

- 大模型数据方案

- 数据采集治理

- 数据交易

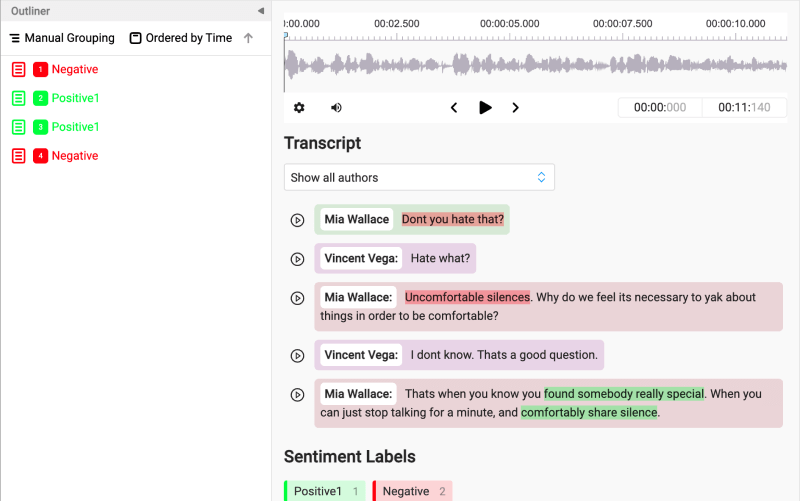

本文介绍了一个名为StoryBench的新型多任务基准测试集,用于可靠地评估未来的文本到视频生成模型。该基准测试集包括三个难度递增的视频生成任务:动作执行(Action Execution),在此任务中,下一个动作必须从一个条件视频开始生成;故事延续(Story Continuation),在此任务中,...

论文作者

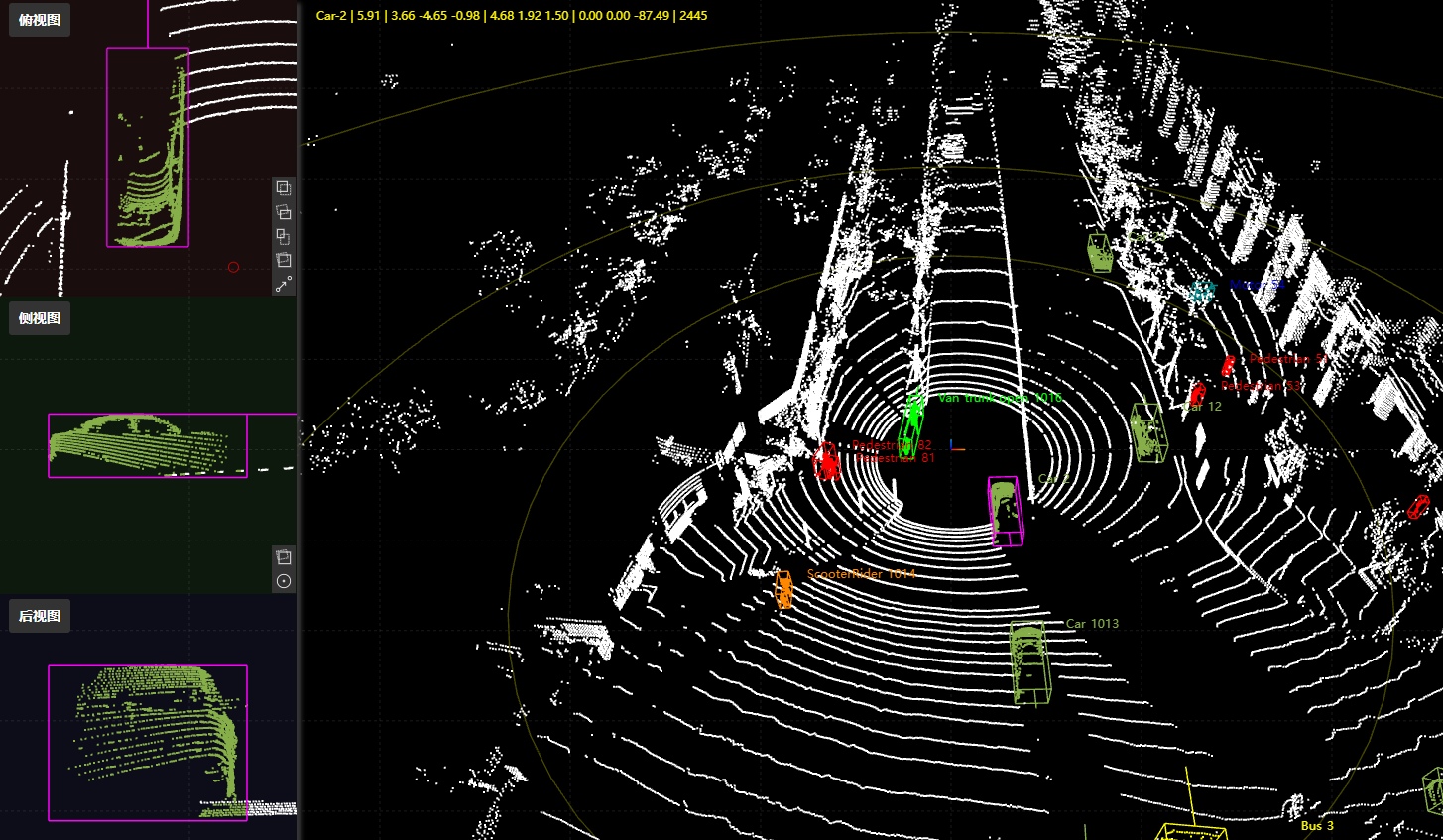

本文探讨了单目3D目标检测的最新进展,这使得基于低成本相机传感器的3D多目标跟踪任务成为可能。我们发现,不同时间帧上物体的运动线索对于3D多目标跟踪至关重要,这在现有的单目方法中尚未得到充分探索。因此,本文提出了一种单目3D MOT的运动感知框架MoMA-M3T,该框架主要由三个...

论文作者

研究机构

来自香港科技大学,华中科技大学,加州大学洛杉矶分校

本文介绍了一种名为GRIP的基于学习的方法,用于捕捉和建模人体与物体的真实互动,包括手指的微小运动,对于计算机图形学、计算机视觉和混合现实应用非常重要。与以往注重捕捉和建模人体和物体运动的工作不同,GRIP将人体和物体的三维运动作为输入,然后在物体互动之前、期间和之后...

论文作者

本文研究了少样本物理感知的关节网格生成问题。通过观察仅包含少量示例的关节对象数据集,我们希望学习一个模型,可以生成具有高视觉保真度和物理有效性的多样化网格。以往的网格生成模型要么难以从仅有的少量示例中描述多样化的数据空间,要么无法确保其样本的物理有效性。针对上...